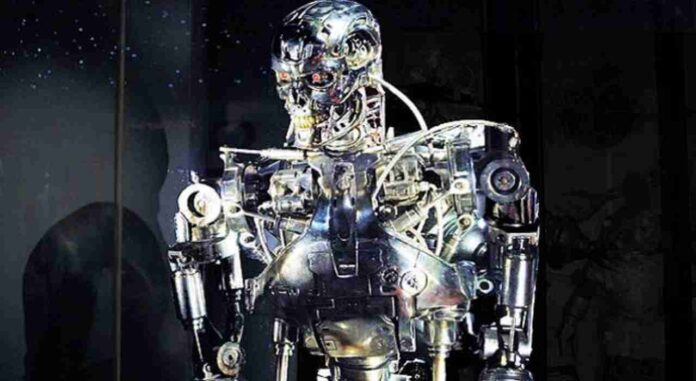

Elon Musk viene dal futuro (o è un alieno atterrato sul nostro pianeta) come dicono molti e ci sta avvisando su come le macchine diventeranno ribelli introducendoci alla trama di “Terminator”? Oppure Steve Wozniak (co-creatore di Apple) in base a calcoli e algoritmi ha predetto la fine della storia ed ha visto che l’Intelligenza Artificiale – che sta meravigliando tutti con le sue potenzialità – riuscirà a governare l’uomo?

Scherzi a parte, l’A.I. non sarebbe un pericolo da sottovalutare, basti pensare che proprio Musk era stato uno dei primi imprenditori a lanciarsi sullo sviluppo dell’intelligenza artificiale – è infatti stato finanziatore di OpenAI all’inizio – per poi spostarsi su posizioni più conservatrici, ma ora firma un appello in cui si dichiara l’intelligenza artificiale più pericolosa della bomba atomica e sul lungo termine una minaccia per la sopravvivenza della razza umana.

L’intelligenza artificiale è stata a lungo vista come la panacea per tutti i nostri problemi, un modo per risolvere difficoltà o agevolare con la tecnologia, ma se due figure di spicco rispettivamente di Tesla e Apple, sono tra i firmatari di una lettera aperta che chiede una pausa di sei mesi nello sviluppo di sistemi di intelligenza artificiale avanzati, forse qualche problema c’è.

La petizione è stata organizzata dal Future of Life Institute, un’organizzazione no-profit che ha l’obiettivo di promuovere la ricerca sull’intelligenza artificiale in modo sicuro e responsabile. Secondo l’istituto, la corsa sfrenata per sviluppare l’IA potrebbe portare a conseguenze imprevedibili e potenzialmente pericolose. La pausa di sei mesi richiesta nella petizione sarebbe un modo per rallentare questa corsa, in modo da sviluppare regole più sicure per regolare l’IA.

L’appello ha ottenuto il sostegno di decine di professori e ricercatori, tra cui lo storico Yuval Noah Harari. Anche Musk, che ha iniziato a finanziare la ricerca sull’IA tramite OpenAI, ha ora cambiato posizione, affermando che l’IA potrebbe rappresentare una minaccia per la sopravvivenza della razza umana.

L’IA è stata spesso paragonata alla bomba atomica per il suo potenziale distruttivo, e ci sono molti che sostengono che potrebbe essere ancora più pericolosa a lungo termine. L’appello del Future of Life Institute è un tentativo di rallentare la corsa all’IA e di sviluppare regole più sicure per la sua regolamentazione. Se non verrà presa alcuna azione, gli autori dell’appello ritengono che i governi debbano prendere l’iniziativa e istituire una moratoria.

Molti esperti concordano sul fatto che l’IA rappresenta una delle sfide più importanti dell’epoca moderna. È importante che sia sviluppata in modo responsabile e sicuro, in modo da evitare conseguenze negative per l’umanità. La petizione del Future of Life Institute va verso questo obiettivo, e potrebbe spingere le aziende e i governi di tutto il mondo a prendere sul serio la necessità di regolamentare l’IA. “Immaginate – ci chiede uno del ‘partito catastrofista’ americano via forum – se una versione ancora più evoluta dell’ AI che usiamo già con i nostri pc, fosse collocata nella cpu di un robot indistruttibile?”.

Non ci resterebbe che affidarci a Sarah Connor…

Magari…i robot potrebbero essere più civili di noi ….

Temo chs sia gia’ troppo tardi…

Io non credo all’intelligenza artificiale.

Ma alla stupidità naturale assoluitamente sì